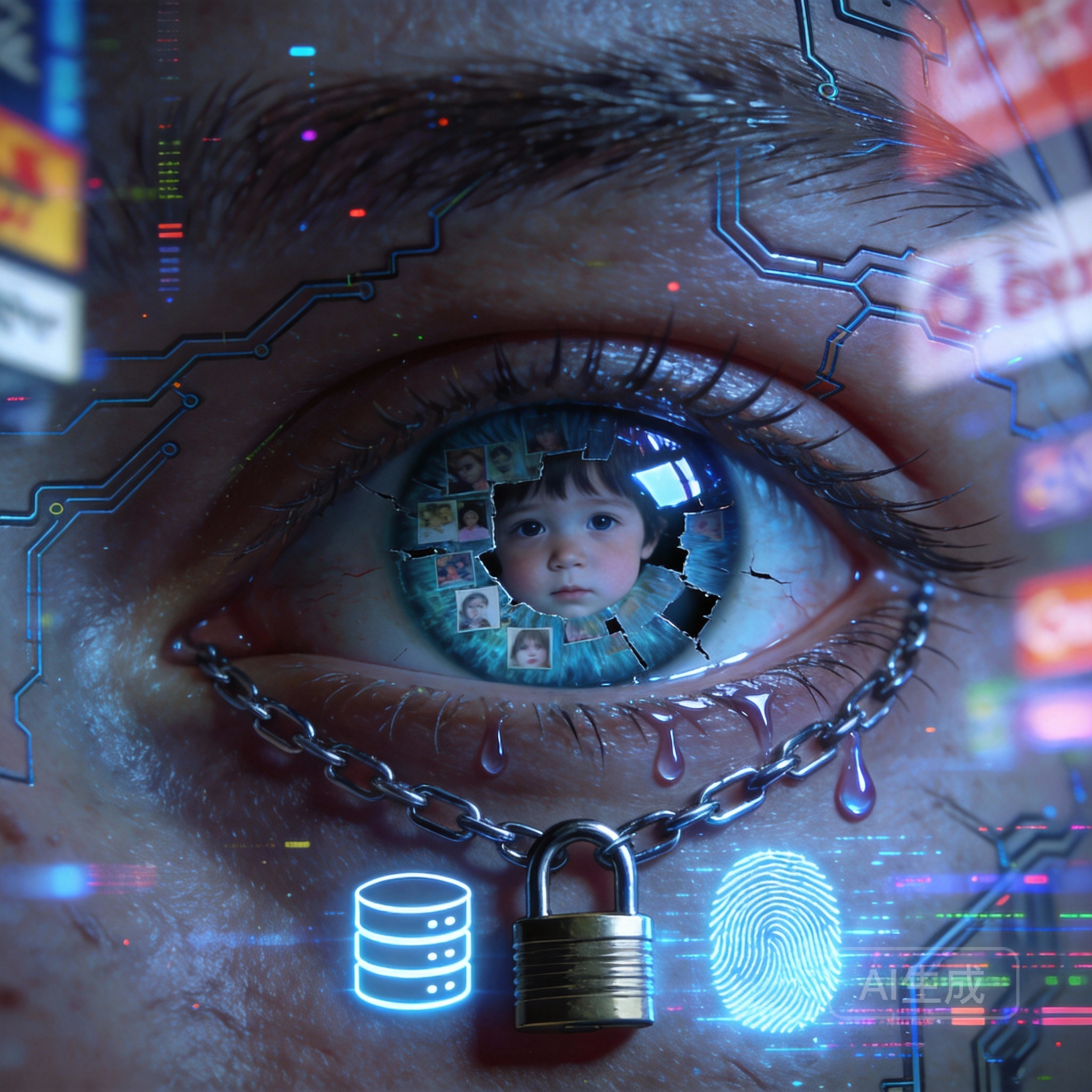

当模型试图“理解”你的年龄

我们交出的数据

究竟换来了安全

还是打开了另一个潘多拉魔盒?

从“猜你喜欢”到“猜你是谁”:AI年龄预测的技术暗面

最近,一些AI公司开始将用户年龄预测功能推向台前,宣称其核心目的是为了保护未成年人。这听起来像是一个充满社会责任感的科技向善故事。但如果我们拨开“保护”这层温情面纱,深入技术肌理,会发现事情远非如此简单。年龄预测本质上是一种生物特征识别,它与你手机的面部解锁同属一个技术家族,但目的和应用场景却可能天差地别。

这项技术通常依赖于计算机视觉和深度学习模型。模型通过分析人脸图像中的成千上万个特征点——例如皮肤纹理、眼角皱纹、骨骼轮廓的细微变化——来估算年龄。这听起来很科幻,但其底层逻辑和教AI识别猫狗没有本质区别,都是通过海量标注数据(即大量标明了真实年龄的人脸照片)训练出来的模式识别机器。然而,“估算” 永远不等于 “判定” ,其准确率受到种族、光照、妆容甚至拍摄角度的巨大影响,误判的可能性始终存在。

数据、伦理与难以划定的边界

一旦技术启动,伦理的拷问便接踵而至。首当其冲的是数据隐私与授权问题。为了训练一个精准的年龄预测模型,需要收集并标注海量的人脸生物特征数据。这些数据从何而来?用户是否在完全知情且自愿的情况下,授权自己的面部信息被用于此类模型的训练?更微妙的是,“年龄” 是一个极其敏感的个人属性。当平台不仅能推测你的喜好,还能推断你的年龄层时,其用户画像的精确度和侵入性便达到了一个新的维度。

这自然引出了第二个问题:功能漂移。今天,这项技术被郑重地包装为“未成年人保护工具”,但明天它是否会悄然变身,成为广告系统进行精准年龄歧视营销的利器?或是信贷、保险等领域进行隐性风险评估的参考?技术的初始善意,并不能为其所有潜在应用背书。历史一再告诉我们,一项强大的工具,其用途最终取决于掌握它的人的目的。在代码的世界里,一个“if-else”判断句的改写,就足以让保护机制滑向商业剥削的深渊。

构建负责任的AI:需要透明,而非黑箱

那么,我们是否要因噎废食,全然拒绝这类技术?答案并非简单的“是”或“否”。关键在于如何构建一套透明、可审计、权责分明的技术应用框架。这不仅仅是工程师的任务,更需要产品经理、法律专家、伦理学家乃至公众的参与。

首先,算法透明化至关重要。平台有义务以清晰易懂的方式,向用户说明年龄预测功能的存在、工作原理、所用数据范围及其局限性。用户应当拥有绝对的选择权和控制权——可以轻松开启或关闭此功能,并查询、删除相关的特征数据。其次,必须建立严格的内部审计和外部监督机制,确保该技术不会被滥用至初始声明以外的场景。最后,作为用户,我们需要保持一种健康的“技术警惕性”,在享受便利的同时,不断追问:这项技术拿走了我什么?又真正还给了我什么?

科技的前行总是伴随着光影交错。年龄预测这类技术,如同一把锋利的双刃剑,一面铭刻着保护的承诺,另一面则映照着隐私的隐忧。它的未来形态,并不完全由代码决定,更取决于我们如何在创新与约束、便利与权利之间,找到那个动态且脆弱的平衡点。当我们允许机器“阅读”我们的面容时,或许我们也该擦亮眼睛,更清醒地“阅读”技术背后的逻辑与意图。

信息参考与延伸方向

- 本文思考由AI年龄预测功能的相关信息引发,并延伸至计算机视觉、生物特征识别、机器学习伦理等范畴。

- 关于生物特征数据隐私,可进一步了解差分隐私、联邦学习等旨在数据利用与隐私保护间取得平衡的前沿技术。

- 推荐阅读相关书籍与论文,如《算法霸权》、《监控资本主义时代》等,以建立更系统的技术社会性思考框架。

配图参考区:

本文作者为izhu,转载请注明。